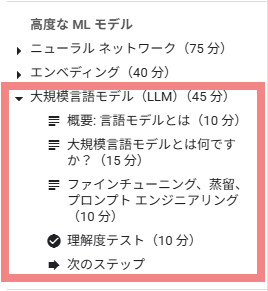

お惚け老人も学べば立派になれるかもしれないGoogle様のMACHINE LEARNING CRASH COURSEを学ぶ全12ユニットの第9回です。今回は「遂に」大規模言語モデル(LLM)です。ホンワカした説明はアチコチで目にするけれど、クラッシュコースの解説は腑に落ちるのか。分かった、ような気がするのは気のせい?

大規模言語モデル(LLM)

前回のように、インタラクティブな演習ツールの操作の面白さに時間を忘れるということもありません。今回はただたた「座学」回みたいデス。例によって機械翻訳の日本語のアラに、ところどころ引っかかっておるのですが、これにも慣れました。御愛嬌。それどころか、機械翻訳の日本語に「腑に落ちる」名言などもあり。曰く(以下引用)、

数学的な「文章問題」を大量にトレーニングした LLM は、高度な数学的推論を行っているように見えることがあります。ただし、これらの LLM は基本的に、数式の問題の入力を自動的に補完するだけです。

別シリーズ記事にて、上記の引用に該当するようなケースを目にすることになるでしょう、きっと。また、こうも書かれてます(これまた機械翻訳の日本語だけれども)

LLM は幻覚を起こすため、予測に誤りが含まれることがよくあります。

そだね~。幻覚(ハルシネーション)に気づくためには「正気」を保っていないとならないようです。お惚け老人、大丈夫か?頭の中、能天気じゃないか?

演習結果

まあ、「座学」の結果は以下のごとし。とりあえず自分の脳内モデルは「今のところまともに見えてる」のかも。